Planungsfehlschluss

Der Planungsfehlschluss (englisch planning fallacy) ist die Tendenz von Menschen und Organisationen, zu unterschätzen, wie viel Zeit sie zur Vollendung einer Aufgabe benötigen.

Allgemeines[Bearbeiten | Quelltext bearbeiten]

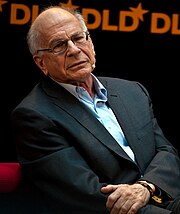

Der englische Begriff wurde zum ersten Mal von Daniel Kahneman und Amos Tversky in einer Veröffentlichung von 1979 vorgeschlagen.[1][2] Der Effekt erlaubt Vorhersagen für eine weite Bandbreite an Aufgaben, darunter das Ausfüllen von Steuerunterlagen, Hausaufgaben, der Aufbau von Möbeln, Programmieren und Origami.[1][3] Der Fehlschluss beeinflusst nur Vorhersagen über eigene Aufgaben; wenn außenstehende Beobachter die Zeit bis zur Fertigstellung einer Aufgabe vorhersagen, zeigen sie eine pessimistische Tendenz und überschätzen die erforderliche Zeit.[3][4] Lovallo und Kahneman schlugen 2003 eine erweiterte Definition des Planungsfehlschlusses vor, nämlich als die Tendenz, die Zeit, Kosten und/oder Risiken von künftigen Handlungen zu unterschätzen und zugleich die Vorteile dieser Handlungen zu überschätzen. Nach dieser Definition führt der Planungsfehlschluss nicht nur zur Überschreitung des geplanten Zeitrahmens, sondern auch zu Kostenexplosionen und geringerem Nutzen als geplant.[5]

Studien und Beispiele[Bearbeiten | Quelltext bearbeiten]

In einer Studie von 1994 wurden 37 Psychologiestudenten gebeten, zu schätzen, wie lange sie für die Fertigstellung ihrer Abschlussarbeiten bräuchten. Der durchschnittliche Schätzwert war 33,9 Tage. Sie schätzten ebenfalls, wie lange sie bräuchten „wenn alles so gut liefe wie nur möglich“ (mit einem Durchschnitt von 27,4 Tagen) und „wenn alles so schlecht liefe wie nur möglich“ (mit einem Durchschnitt von 48,6 Tagen). Die durchschnittliche tatsächliche Zeit zur Vollendung war 55,5 Tage, wobei nur 30 % der Studenten ihre Arbeit in der vorhergesagten Zeit fertigstellten.[6]

Eine weitere Studie beauftragte Studenten, zu schätzen, wann sie ein studienbezogenes Projekt fertigstellen würden. Die Forscher fragten nach den geschätzten Zeiten, zu denen die Studenten mit 50 %, 75 %, und 99 % Wahrscheinlichkeit erwarteten, mit ihren Projekten fertig zu werden.[4]

- 13 % der Teilnehmer vollendeten ihr Projekt innerhalb der Zeit, der sie eine Wahrscheinlichkeit von 50 % für die Fertigstellung zugewiesen hatten;

- 19 % wurden innerhalb der Zeit fertig, der sie 75 % Wahrscheinlichkeit zugewiesen hatten;

- 45 % wurden innerhalb der Zeit fertig, der sie 99 % Wahrscheinlichkeit zugewiesen hatten.

Eine Umfrage unter kanadischen Steuerzahlern, die 1997 veröffentlicht wurde, berichtete, dass die Befragten ihre Steuerunterlagen ungefähr eine Woche später als vorhergesagt einschickten. Sie waren sich ihrer vergangenen Schwierigkeiten, die Unterlagen rechtzeitig abzusenden, bewusst, aber erwarteten, nächstes Mal schneller fertig zu werden.[7] Dies verdeutlicht ein wichtiges Merkmal des Planungsfehlschlusses; dass Menschen ihre vergangenen Vorhersagen als übermäßig optimistisch erkennen, und gleichzeitig darauf bestehen, dass ihre jetzigen Vorhersagen realistisch sind.[3]

Erklärungen[Bearbeiten | Quelltext bearbeiten]

Kahnemans und Tverskys ursprüngliche Erklärung war, dass sich Menschen beim Planen auf das optimistischste Szenario für die Aufgabe konzentrierten, anstatt ihre volle Erfahrung darüber zu verwenden, wie viel Zeit ähnliche Aufgaben benötigen.[3] Eine Erklärung, die von Roger Buehler und Kollegen angeboten wurde, ist Wunschdenken: Leute denken, dass Aufgaben schnell und leicht fertiggestellt werden, weil sie wollen, dass dies der Fall ist.[1] In einer anderen Veröffentlichung schlagen Buehler und Kollegen eine Erklärung auf Basis der selbstwertdienlichen Verzerrung der vergangenen Leistung vor: Indem sie sich Aufgaben, die gut ausgingen, als Verdienst anrechnen, aber für Verzögerungen äußere Einflüsse verantwortlich machen, können Menschen vergangene Erfahrungen mit schlechter Zeitplanung außer Acht lassen.[1] Ein Experiment hat gezeigt, dass die optimistische Verzerrung ausbleibt, wenn Leute ihre Vorhersagen anonym machten. Dies deutet darauf hin, dass Menschen optimistische Schätzungen abgeben, um einen positiven Eindruck auf Andere zu machen.[1]

Es wurde versucht, den Planungsfehlschluss im Rahmen der Impression-Management-Theorie zu erklären.

Planende tendieren dazu, ihre Aufmerksamkeit auf das Projekt zu fokussieren und die Zeit für Krankheit, Urlaub, Meetings und anderen Mehraufwand zu unterschätzen. Sie neigen außerdem dazu, Projekte nicht bis zu einem solchen Detailgrad zu planen, der die Vorhersage für einzelne Aufgaben erlaubte, wie etwa die Platzierung eines Ziegels in einer Wand. Dies fördert unrealistischen Optimismus (engl. optimism bias) und verhindert, dass die benötigte Zeit mit Messungen vorhergesagt werden kann, wie etwa die Zeitmessung für die Platzierung eines Ziegels und anschließende Multiplikation mit der Anzahl der Ziegel. Außerdem fallen komplexe Projekte, die keine feststehenden Ziele haben, häufig einer schleichenden Ausweitung der Projektziele (engl. mission creep) zum Opfer. Wie Fred Brooks in Der Mythos des Mann-Monats berichtet, resultiert das Hinzufügen von zusätzlichem Personal zu einem bereits verspäteten Projekt in einer Reihe von Risiken und Mehrkosten, die das Projekt unter Umständen sogar noch weiter verspäten. Dies ist als das „Brooksche Gesetz“ bekannt.

Eine weitere mögliche Erklärung ist die Notwendigkeit, die Bewilligung für das Projekt zu erhalten (engl. authorization imperative): Ein großer Teil der Projektplanung findet in einem Kontext statt, in dem die Genehmigung von finanziellen Mitteln nötig ist, um mit dem Projekt fortzufahren. Da der Planende oftmals daran interessiert ist, das Projekt bewilligt zu bekommen, kann diese Dynamik dazu führen, dass der Planende Kosten und Aufwand absichtlich unterschätzt. Es ist einfacher, im Nachhinein die Vergebung der Finanz- oder Auftraggeber für Überziehungen zu bekommen, als zu Beginn eine Erlaubnis für das Projekt mit einer realistischen Kosteneinschätzung zu erhalten.

Methoden zur Vermeidung des Planungsfehlschlusses[Bearbeiten | Quelltext bearbeiten]

Daniel Kahneman, Amos Tversky und Bent Flyvbjerg entwickelten das sog. reference class forecasting, um die Effekte des Planungsfehlschlusses beim Treffen von Entscheidungen zu eliminieren oder zu reduzieren.[8] Dabei wird die Vorhersage anhand von den Ergebnissen ähnlicher Situationen in der Vergangenheit erstellt.

Siehe auch[Bearbeiten | Quelltext bearbeiten]

Einzelnachweise[Bearbeiten | Quelltext bearbeiten]

- ↑ a b c d e Mark V. Pezzo, Jordan A. Litman, Stephanie P. Pezzo: On the distinction between yuppies and hippies: Individual differences in prediction biases for planning future tasks. In: Personality and Individual Differences. 41. Jahrgang, Nr. 7, 2006, ISSN 0191-8869, S. 1359–1371, doi:10.1016/j.paid.2006.03.029.

- ↑ Daniel Kahneman, Amos Tversky: Intuitive prediction: biases and corrective procedures. In: TIMS Studies in Management Science. 12. Jahrgang, 1979, S. 313–327.

- ↑ a b c d Buehler, Roger; Griffin, Dale, & Ross, Michael (2002). „Inside the planning fallacy: The causes and consequences of optimistic time predictions“. In Thomas Gilovich, Dale Griffin, & Daniel Kahneman (Eds.), Heuristics and biases: The psychology of intuitive judgment, pp. 250–270. Cambridge, UK: Cambridge University Press.

- ↑ a b Roger Buehler, Dale Griffin, Michael Ross: It’s about time: Optimistic predictions in work and love. In: European Review of Social Psychology. 6. Jahrgang. American Psychological Association, 1995, S. 1–32, doi:10.1080/14792779343000112.

- ↑ Dan Lovallo, Daniel Kahneman: Delusions of Success: How Optimism Undermines Executives’ Decisions. In: Harvard Business Review. Juli 2003, S. 56–63.

- ↑ Roger Buehler, Dale Griffin, Michael Ross: Exploring the „planning fallacy“: Why people underestimate their task completion times. In: Journal of Personality and Social Psychology. 67. Jahrgang, Nr. 3. American Psychological Association, 1994, S. 366–381, doi:10.1037/0022-3514.67.3.366.

- ↑ Roger Buehler, Dale Griffin, Johanna Peetz: The Planning Fallacy: Cognitive, Motivational, and Social Origins. In: Advances in Experimental Social Psychology. 43. Jahrgang, 2010, S. 9 (nyu.edu [PDF; abgerufen am 15. September 2012]).

- ↑ Flyvbjerg, B., 2008, „Curbing Optimism Bias and Strategic Misrepresentation in Planning: Reference Class Forecasting in Practice.“ ( des vom 5. Juli 2012 im Internet Archive) Info: Der Archivlink wurde automatisch eingesetzt und noch nicht geprüft. Bitte prüfe Original- und Archivlink gemäß Anleitung und entferne dann diesen Hinweis. (PDF-Datei; 287 kB) European Planning Studies, vol. 16, no. 1, January, pp. 3–21.

Literatur[Bearbeiten | Quelltext bearbeiten]

- Justin Kruger, Matt Evans: If you don't want to be late, enumerate: Unpacking reduces the planning fallacy. In: Journal of Experimental Social Psychology. 40, 2004, S. 586, doi:10.1016/j.jesp.2003.11.001.

- Lev Virine und Michael Trumper. Project Decisions: The Art and Science, Vienna, VA: Management Concepts, 2008. ISBN 978-1-56726-217-9