Optische Notenerkennung

Optische Notenerkennung (englisch Optical Music Recognition, Abkürzung: OMR) ist das Forschungsfeld, das das computergestützte Lesen musikalischer Notenschrift in Dokumenten untersucht.[1] Das Ziel ist es, aus einem vorliegenden Notentext die Noten in einer maschinenverständlichen Form zu extrahieren, so dass sie in verschiedene Formate exportiert werden kann, um die Musik wiederzugeben (z. B. mittels MIDI) oder erneut zu setzen (z. B. mittels MusicXML).

In der Vergangenheit wurde OMR auch als Form der optischen Zeichenerkennung angesehen und Music OCR genannt. Aufgrund zahlreicher signifikanter Unterschiede sollten diese Ausdrücke jedoch nicht vermischt und die Bezeichnung Music OCR vermieden werden.[2]

Geschichte

[Bearbeiten | Quelltext bearbeiten]

Forschung im Bereich der optischen Notenerkennung begann in den späten 1960ern am MIT, als die ersten Scanner für Forschungszwecke leistbar wurden.[3][4][5] Da der Arbeitsspeicher der verwendeten Computer ein limitierender Faktor war, beschränkten sich die ersten Versuche auf wenige Takte (siehe den ersten publizierten Scan). 1984 entwickelte eine japanische Forschungsgruppe an der Waseda-Universität einen spezialisierten Roboter namens WABOT (WAseda roBOT), welcher die gedruckten Noten vor sich lesen und einen Sänger auf einer elektrischen Orgel begleiten konnte.[6][7]

Entscheidende Forschungsfortschritte in der Anfangszeit wurden von Ichiro Fujinaga, Nicholas Carter, Kia Ng, David Bainbridge und Tim Bell erbracht, die eine Reihe von Ansätzen entwickelt haben, die heute noch in einigen Systemen verwendet werden.

Mit zunehmender Verfügbarkeit von kostengünstigen Scannern konnten sich mehr Forscher der optischen Notenerkennung widmen, und die Anzahl der Projekte nahm zu. 1991 wurde die erste kommerzielle Lösung MIDISCAN (inzwischen SmartScore) von der Musitek Corporation entwickelt.

Mit der Verbreitung von Smartphones, die mit ausreichend guten Kameras und genügend Rechenkapazität ausgestattet sind, wurden einige mobile Lösungen möglich, bei denen mit dem Smartphone aufgenommenen Fotos direkt am Gerät verarbeitet werden.

Beziehung zu anderen Forschungsgebieten

[Bearbeiten | Quelltext bearbeiten]Die optische Notenerkennung steht in Beziehung zu einigen anderen Forschungsgebieten, insbesondere zu maschinellem Sehen, Dokumentenanalyse und Music Information Retrieval. Aus Sicht der musikalischen Praxis kann OMR als Eingabemethode von Noten in den Computer verstanden werden, wodurch das Bearbeiten und Transkribieren von Musiknoten sowie das Komponieren erleichtert werden kann. In Bibliotheken kann OMR genutzt werden, um Notenarchive durchsuchbar zu machen,[8] und musikwissenschaftliche Studien können dank OMR kostengünstig im großen Rahmen durchgeführt werden.[9]

OMR vs. OCR

[Bearbeiten | Quelltext bearbeiten]Optische Notenerkennung wird häufig mit optischer Zeichenerkennung (engl. Optical Character Recognition, kurz OCR) verglichen. Obwohl es viele Gemeinsamkeiten gibt, ist die Bezeichnung „Music OCR“ aufgrund von entscheidenden Unterschieden irreführend. Der erste Unterschied ist, dass Musiknotation ein konfiguratives Schreibsystem ist. Das bedeutet, dass die Semantik nicht von den verwendeten Symbolen abhängig ist (z. B. Notenköpfe, Notenhälse, Fähnchen), sondern von der Art, wie diese auf den Notenzeilen platziert werden. Zwei-dimensionale Beziehungen und der Kontext sind entscheidend für die korrekte Interpretation von Noten. Im Gegensatz dazu ist bei Text üblicherweise nur die Textlinie entscheidend – geringfügige Abweichungen davon verändern nicht die Bedeutung des Textes. Er kann also als eindimensionaler Fluss von Informationen entlang der Textlinie angesehen werden.

Der zweite große Unterschied liegt an den Erwartungen. Ein OCR-System endet üblicherweise bei der Erkennung von Buchstaben und Wörtern, von einem OMR-System wird hingegen erwartet, dass es auch die Semantik rekonstruiert (z. B. aus einem gefüllten Notenkopf und einem angehängten Notenhals darauf schließt, dass es sich um eine Note mit einer bestimmten Dauer handelt). Die graphischen Konzepte (Position, Art des Symbols) müssen also in musikalische Konzepte (Tonhöhe, Notendauer …) durch Anwenden der Regeln von Musiknotation übersetzt werden. In der Texterkennung gibt es kein passendes Äquivalent für diesen Schritt; die Anforderungen an ein OMR-System sind daher ähnlich komplex, wie die Erwartung, dass OCR aus dem Screenshot einer Webseite den HTML-Quellcode rekonstruiert.

Der dritte große Unterschied ist der Zeichensatz. Während es auch in anderen Schriftsystemen wie der chinesischen Schrift ausgesprochen komplexe Symbole und umfangreiche Zeichensätze gibt, ist der Zeichensatz von Musiknotation dadurch geprägt, dass die Symbole enorme Größenunterschiede haben können – von kleinen Punkten bis hin zu Klammern, die eine ganze Seite umspannen. Manche Symbole haben sogar eine nahezu unbeschränkte Darstellungsart wie Binde- und Phrasierungsbögen, die lediglich als mehr oder weniger glatte Kurven definiert werden, die beliebig unterbrochen werden können.

Verfahren

[Bearbeiten | Quelltext bearbeiten]

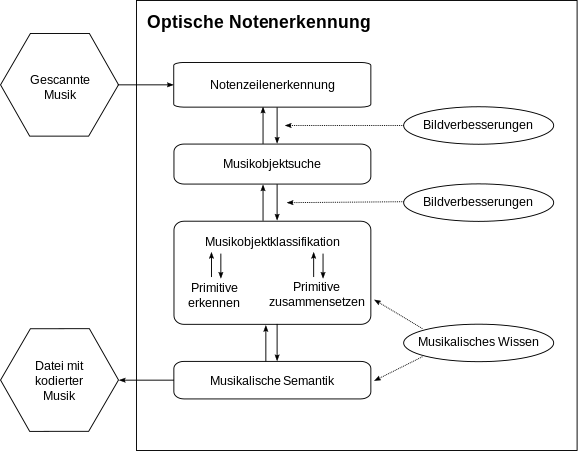

Die Erkennung von Noten erfolgt üblicherweise in mehreren Teilschritten, die mittels spezieller Algorithmen aus dem Bereich der Mustererkennung gelöst werden.

Eine Reihe von konkurrierender Ansätze existiert, wobei die meisten eine Art Pipeline vorsehen, wo jeder Schritt eine spezielle Funktion erfüllt, z. B. das Erkennen und Entfernen von Notenlinien, bevor der nächste Schritt ausgeführt wird. Ein häufiges Problem dieser Methoden ist, dass sich Fehler durch das System fortpflanzen und vermehren. Zum Beispiel führt das Übersehen von Notenzeilen in den ersten Schritten dazu, dass die folgenden Schritte diesen Bereich des Bildes vermutlich ignorieren werden, wodurch die Ausgabe unvollständig ist.

Die optische Notenerkennung wird häufig unterschätzt, da es sich um ein scheinbar einfaches Problem handelt: Arbeitet man mit einem perfekten Scan von gedruckten Noten, kann die visuelle Erkennung mit einer Reihe von relativ einfachen Algorithmen wie Projektionen oder Pattern Matching gelöst werden. Der Prozess wird jedoch signifikant schwieriger, wenn der Scan eine niedrige Qualität aufweist oder wenn handschriftliche Notizen erkannt werden sollen – eine Herausforderung, an der fast alle Systeme scheitern. Selbst bei einer perfekten visuellen Erkennung stellt die Rekonstruktion der musikalischen Semantik aufgrund von Mehrdeutigkeiten und häufigen Verletzungen der Regeln der Musiknotation (wie in Chopins Nocturne) noch immer eine große Herausforderung dar. Donald Byrd und Jakob Simonsen behaupten, dass OMR deshalb so schwierig ist, weil moderne Musiknotation enorm komplex ist.[10]

Donald Byrd hat eine Reihe von interessanten Beispielen auf seiner Website gesammelt[11] sowie einige extreme Beispiele, welche demonstrieren wie weit die Regeln der Musiknotation gebogen werden können.[12]

Ausgaben von OMR Systemen

[Bearbeiten | Quelltext bearbeiten]OMR-Systeme erzeugen typischerweise eine Version der Noten, die akustisch wiedergegeben werden kann (Wiedergabefähigkeit, engl. Replayability). Die häufigste Art, wie so eine Version erzeugt werden kann, ist über die Generierung einer MIDI-Datei, die mithilfe von einem Synthesizer in eine Audiodatei umgewandelt werden kann. MIDI Dateien sind jedoch eingeschränkt in der Information, die sich speichern können. So können diese beispielsweise keinerlei Information über den visuellen Notensatz (wie die Noten konkret angeordnet waren) speichern.

Ist das Ziel der Software die Herstellung einer Version, die gedruckt und von Menschen gut gelesen werden kann, muss die vollständige Information wiederhergestellt werden, inklusive präziser Layoutinformationen des Notensatzes. Geeignete Formate für diese Aufgaben sind MEI und MusicXML.

Neben den beiden genannten Anwendungen kann es auch interessant sein, aus einem Bild lediglich Metainformation zu extrahieren, oder dieses nur durchsuchbar zu machen. Hier mag ein geringeres Verständnis der Noten ausreichend sein.

Generelles Modell (2001)

[Bearbeiten | Quelltext bearbeiten]Im Jahr 2001 veröffentlichten David Bainbridge und Tim Bell einen Überblick über die Forschungsaktivitäten, die bis dahin stattgefunden hatten. Sie extrahierten daraus ein generelles Modell für OMR, welches nach 2001 als Vorlage für zahlreiche System diente.[13] Sie unterteilten die Aufgabe in vier Schritte, die sich hauptsächlich mit der visuellen Erkennung befassen. Die Autoren stellten fest, dass das Erkennen der musikalischen Semantik in wissenschaftlichen Arbeiten häufig nicht beschrieben wird, da diese Operationen auch vom Ausgabeformat abhängen.

Verfeinertes Modell (2012)

[Bearbeiten | Quelltext bearbeiten]Im Jahr 2012 verfassten Ana Rebelo et al. eine weitere Untersuchung über die verwendeten Techniken zur optischen Notenerkennung.[14] Die gefundenen Arbeiten wurden kategorisiert, und ein verfeinertes Modell wurde vorgeschlagen mit vier Hauptbestandteilen: Vorverarbeitung, Musiksymbolerkennung, Rekonstruktion der Musiknotation und Konstruktion der finalen Repräsentation. Dieses Modell wurde der de-facto Standard für OMR und wird noch heute so verwendet (wenn auch manchmal mit leicht abweichenden Namen). Für jeden dieser vier Blöcke gibt die Arbeit einen Überblick über die hierzu verwendeten Techniken. Die Arbeit war 2019 die am häufigsten zitierte Publikation.

Deep Learning (seit 2016)

[Bearbeiten | Quelltext bearbeiten]Mit dem Aufkommen von Deep Learning haben sich viele Probleme der maschinellen Erkennung gewandelt, da an die Stelle händisch erstellter Heuristiken und dem Entwickeln geeigneter Merkmale das maschinelle Lernen getreten ist. Die Notenzeilenverarbeitung,[15] die Musiksymbolerkennung[16][17][18][19] sowie die Rekonstruktion der Musiknotation[20] haben durch Deep Learning signifikante Fortschritte erfahren.

Teilweise entstanden sogar völlig neue Methoden, die versuchen, OMR direkt durch Verwendung von Sequenz-zu-Sequenz-Modellen zu erreichen. Diese Verfahren wandeln ein Bild von Musiknoten direkt in eine vereinfachte Sequenz von erkannten Noten um.[21][22][23][24]

Bedeutsame wissenschaftliche Projekte

[Bearbeiten | Quelltext bearbeiten]Wettbewerb zur Notenzeilenerkennung

[Bearbeiten | Quelltext bearbeiten]Für Systeme, die vor 2016 entwickelt wurden, stellte die Erkennung und das Entfernen der Notenlinien eine signifikante Herausforderung dar. Ein wissenschaftlicher Wettbewerb wurde organisiert, um den Stand der Technik für dieses Problem zu verbessern.[25] Nachdem bereits sehr gute Ergebnisse erzielt werden konnten und viele moderne Ansätze keine explizite Notenzeilenerkennung mehr benötigen, wurde dieser Wettbewerb nicht weitergeführt.

Ein wichtiger Beitrag dieses Wettbewerbes war die Entwicklung und Veröffentlichung des frei verfügbare CVC-MUSCIMA-Datensatzes. Dieser besteht aus 1000 hochqualitativen Bildern handgeschriebener Noten. 50 verschiedene Musiker transkribierten jeweils eine Seite aus 20 musikalischen Werken unterschiedlichster Art. Eine Weiterentwicklung von CVC-MUSCIMA ist der MUSCIMA++ Datensatz, welcher für 140 ausgewählte Seiten noch weitere detaillierte Annotation enthält.

SIMSSA

[Bearbeiten | Quelltext bearbeiten]Das Single Interface for Music Score Searching and Analysis (SIMSSA) Projekt[26] ist das vermutlich größte Forschungsprojekt der optischen Notenerkennung. Das Ziel ist die effiziente Bereitstellung von großen Mengen an durchsuchbaren Noten in elektronischer Form. Einige Unterprojekte wurden bereits erfolgreich abgeschlossen, zum Beispiel das Liber-Usualis-Projekt[27] und das Cantus-Ultimus-Projekt.[28]

TROMPA

[Bearbeiten | Quelltext bearbeiten]Ein weiteres internationales Forschungsprojekt mit dem Ziel, gemeinfreie, digitale Musikressourcen zugänglicher zu machen, ist das Towards Richer Online Music Public-Domain Archives (TROMPA).[29]

Handgeschriebene Datensätze

[Bearbeiten | Quelltext bearbeiten]Die Entwicklung von OMR-Systemen wird maßgeblich davon beeinflusst, welche Datensätze zur Entwicklung herangezogen werden. Ein ausreichend großer und diverser Datensatz hilft dem zu entwickelnden System, auch mit unterschiedlichsten Eingaben zurechtzukommen. Da Musiknoten durch das Urheberrecht geschützt sind, kann es kompliziert sein, einen entsprechenden Datensatz zu erstellen und zu veröffentlichen. Dennoch gibt es eine Reihe an Datensätzen, die das OMR Dataset Projekt[30] gesammelt und zusammengefasst hat. Die bedeutendsten sind CVC-MUSCIMA,[31] MUSCIMA++,[32] DeepScores,[33] PrIMuS,[34] HOMUS,[35] und der SEILS Datensatz,[36] sowie die Universal Music Symbol Sammlung.[37]

Software

[Bearbeiten | Quelltext bearbeiten]Akademische und quelloffene Software

[Bearbeiten | Quelltext bearbeiten]Trotz einer großen Anzahl wissenschaftlicher OMR-Projekte erreichten nur wenige davon einen derart ausgereiften Zustand, dass das Ergebnis an Anwender weitergegeben wurde. Diese Systeme sind:

Kommerzielle Software

[Bearbeiten | Quelltext bearbeiten]Die meisten kommerziellen Desktopanwendungen, die in den letzten 20 Jahren veröffentlicht wurden, sind wegen des mangelnden kommerziellen Erfolgs wieder vom Markt verschwunden. Nur ein paar wenige Anbieter entwickeln, warten und verkaufen derzeit noch OMR-Produkte. Manche dieser Produkte behaupten, Erkennungsraten von nahezu 100 % zu haben,[45][46] da aber die Kriterien für diese Behauptung unbekannt sind, ist es nahezu unmöglich, verschiedene Produkte miteinander zu vergleichen.

Neben den Desktopanwendungen wurde auch eine Reihe mobiler Anwendungen entwickelt. Alle diese Projekte wurden jedoch wieder eingestellt (oder zumindest seit 2017 nicht mehr aktualisiert).[47][48][49] Eine Reihe an OMR-Anwendungen wurden auch für das iPhone und iPad entwickelt und sind im Apple Store verfügbar.[50][51][52][53][54]

- capella-scan[55]

- ForteScan Light von Fortenotation[56] heute Scan Score[57]

- MIDI-Connections Scan von MIDI-Connections[58]

- MP Scan von Braeburn[59] verwendet das SharpEye SDK.

- NoteScan gebündelt mit Nightingale[60]

- OMeR (Optical Music easy Reader) Add-on for Harmony Assistant and Melody Assistant: Myriad Software[61] (ShareWare)

- PDFtoMusic[62]

- PhotoScore von Neuratron.[46] The Light version of PhotoScore is used in Sibelius. PhotoScore verwendet das SharpEye SDK.

- Scorscan von npcImaging.[63] Based on SightReader(?)

- SharpEye von Visiv[64]

- VivaldiScan (genauso wie SharpEye)[65]

- SmartScore von Musitek.[66] Früher als „MIDISCAN“ verkauft. (SmartScore Lite wurde in früheren Versionen von Finale verwendet).

- ScanScore von Lugert Verlag[67] (Auch im Bundle mit Forte Notensatz.)[68]

Siehe auch

[Bearbeiten | Quelltext bearbeiten]- Mustererkennung

- Musteranalyse

- Texterkennung befasst sich mit der Erkennung von geschriebenem Text, womit gescannte Dokumente durchsuchbar gemacht werden. OMR kann eine ähnliche Funktion in Music Information Retrieval übernehmen – allerdings muss ein vollständiges OMR-System auch enthaltenen sprachlichen Text wie Gesangstexte und Vortragsbezeichnungen erkennen, weshalb OCR als ein Teilproblem von OMR angesehen werden kann.[13]

- Music Information Retrieval

- Notensatzprogramm

Weblinks

[Bearbeiten | Quelltext bearbeiten]- Website über Forschungsaktivitäten im Bereich der optischen Notenerkennung

- Github page for open-source projects on optical music recognition

- Bibliography on OMR-Research

- Recording of the ISMIR 2018 tutorial Optical Music Recognition for Dummies

- Optical Music Recognition (OMR): Programs and scientific papers

- OMR (Optical Music Recognition) Systems – Ausführlicher Überblick über OMR Systeme (Zuletzt aktualisiert am: 30 January 2007).

- Gerd Castan: Deutsche Notenscan-Übersichtsseite.

- Andrew H. Bullen: Bringing Sheet Music to Life: My Experiences with OMR.

Einzelnachweise

[Bearbeiten | Quelltext bearbeiten]- ↑ Alexander Pacha: Self-Learning Optical Music Recognition (Doktorarbeit). 2019, doi:10.13140/RG.2.2.18467.40484 (Online Verfügbar).

- ↑ Jorge Calvo-Zaragoza, Jan jr. Hajič, Alexander Pacha: Understanding Optical Music Recognition. In: Computing Research Repository. 2019, ISSN 2331-8422, S. 1–42, arxiv:1908.03608 (englisch).

- ↑ Fujinaga, Ichiro (2018). Die Geschichte von OMR (Englisch) auf YouTube, abgerufen am 30. Juli 2019.

- ↑ Dennis Howard Pruslin: Automatic Recognition of Sheet Music (Doktorarbeit). Hrsg.: Massachusetts Institute of Technology, Cambridge, Massachusetts, USA. 1966.

- ↑ David S. Prerau: Computer pattern recognition of printed music. Fall Joint Computer Conference. 1971, S. 153–162 (englisch).

- ↑ WABOT – WAseda roBOT. Waseda University Humanoid, abgerufen am 30. Juli 2019.

- ↑ Wabot’s entry in the IEEE collection of Robots. IEEE, abgerufen am 30. Juli 2019.

- ↑ Audrey Laplante, Ichiro Fujinaga: Digitizing Musical Scores: Challenges and Opportunities for Libraries. 3rd International Workshop on Digital Libraries for Musicology. 2016, S. 45–48 (englisch).

- ↑ Jan jr. Hajič, Marta Kolárová, Alexander Kolárová, Jorge Calvo-Zaragoza: How Current Optical Music Recognition Systems Are Becoming Useful for Digital Libraries. 5th International Conference on Digital Libraries for Musicology. Paris, France 2018, S. 57–61 (englisch).

- ↑ Donald Byrd, Jakob Grue Simonsen: Towards a Standard Testbed for Optical Music Recognition: Definitions, Metrics, and Page Images. In: Journal of New Music Research. 44. Jahrgang, Nr. 3, 2015, S. 169–195, doi:10.1080/09298215.2015.1045424 (englisch).

- ↑ Donald Byrd: Gallery of Interesting Music Notation. Abgerufen am 30. Juli 2019 (englisch).

- ↑ Donald Byrd: Extremes of Conventional Music Notation. Abgerufen am 30. Juli 2019 (englisch).

- ↑ a b David Bainbridge, Tim Bell: The challenge of optical music recognition. In: Computers and the Humanities. 35. Jahrgang, Nr. 2, 2001, S. 95–121, doi:10.1023/A:1002485918032 (englisch, researchgate.net).

- ↑ Ana Rebelo, Ichiro Fujinaga, Filipe Paszkiewicz, Andre R.S. Marcal, Carlos Guedes, Jamie dos Santos Cardoso: Optical music recognition: state-of-the-art and open issues. In: International Journal of Multimedia Information Retrieval. 1. Jahrgang, Nr. 3, 2012, S. 173–190, doi:10.1007/s13735-012-0004-6 (englisch, springer.com [PDF]).

- ↑ Francisco J. Castellanos, Jorge Calvo-Zaragoza, Gabriel Calvo-Zaragoza, Ichiro Fujinaga: Document Analysis of Music Score Images with Selectional Auto-Encoders. 19th International Society for Music Information Retrieval Conference. Paris, France 2018, S. 256–263 (englisch, ircam.fr [PDF]).

- ↑ Lukas Tuggener, Ismail Elezi, Jürgen Elezi, Thilo Stadelmann: Deep Watershed Detector for Music Object Recognition. 19th International Society for Music Information Retrieval Conference. Paris, France 2018, S. 271–278 (englisch, ircam.fr [PDF]).

- ↑ Jan jr. Hajič, Matthias Dorfer, Gerhard Dorfer, Pavel Pecina: Towards Full-Pipeline Handwritten OMR with Musical Symbol Detection by U-Nets. 19th International Society for Music Information Retrieval Conference. Paris, France 2018, S. 225–232 (englisch, ircam.fr [PDF]).

- ↑ Alexander Pacha, Jan jr. Hajič, Jorge Calvo-Zaragoza: A Baseline for General Music Object Detection with Deep Learning. In: Applied Sciences. 8. Jahrgang, Nr. 9, 2018, S. 1488–1508, doi:10.3390/app8091488 (englisch, mdpi.com).

- ↑ Alexander Pacha, Kwon-Young Choi, Bertrand Choi, Yann Ricquebourg, Richard Zanibbi, Horst Eidenberger: Handwritten Music Object Detection: Open Issues and Baseline Results. 13th International Workshop on Document Analysis Systems. 2018, S. 163–168, doi:10.1109/DAS.2018.51 (englisch).

- ↑ Alexander Pacha, Jorge Calvo-Zaragoza, Jan jr. Calvo-Zaragoza: Learning Notation Graph Construction for Full-Pipeline Optical Music Recognition. 20th International Society for Music Information Retrieval Conference. 2019 (englisch, ismir.net [PDF]).

- ↑ Eelco van der Wel, Karen Ullrich: Optical Music Recognition with Convolutional Sequence-to-Sequence Models. 18th International Society for Music Information Retrieval Conference. Suzhou, China 2017 (englisch, ismir.net [PDF]).

- ↑ Jorge Calvo-Zaragoza, David Rizo: End-to-End Neural Optical Music Recognition of Monophonic Scores. In: Applied Sciences. 8. Jahrgang, Nr. 4, 2018, doi:10.3390/app8040606 (englisch, mdpi.com).

- ↑ Arnau Baró, Pau Riba, Jorge Riba, Alicia Fornés: Optical Music Recognition by Recurrent Neural Networks. 14th International Conference on Document Analysis and Recognition. 2017, S. 25–26, doi:10.1109/ICDAR.2017.260 (englisch).

- ↑ Arnaud Baró, Pau Riba, Jorge Calvo-Zaragoza, Alicia Fornés: From Optical Music Recognition to Handwritten Music Recognition: A baseline. In: Pattern Recognition Letters. 123. Jahrgang, 2019, doi:10.1016/j.patrec.2019.02.029 (englisch, sciencedirect.com).

- ↑ Alicia Fornés, Anjan Dutta, Albert Gordo, Josep Lladós: The 2012 Music Scores Competitions: Staff Removal and Writer Identification. In: Graphics Recognition. New Trends and Challenges. Springer, 2013, S. 173–186, doi:10.1007/978-3-642-36824-0_17 (englisch).

- ↑ Website des SIMSSA Projektes. McGill University, abgerufen am 30. Juli 2019 (englisch).

- ↑ The Liber Usualis project website. McGill University, abgerufen am 30. Juli 2019 (englisch).

- ↑ The Cantus Ultimus project website. McGill University, abgerufen am 30. Juli 2019 (englisch).

- ↑ The TROMPA project website. Trompa Konsortium, abgerufen am 30. Juli 2019 (englisch).

- ↑ Pacha, Alexander: The OMR Datasets Project (Github Repository). Abgerufen am 30. Juli 2019 (englisch).

- ↑ Alicia Fornés, Anjan Dutta, Albert Gordo, Josep Lladós: CVC-MUSCIMA: A Ground-truth of Handwritten Music Score Images for Writer Identification and Staff Removal. In: International Journal on Document Analysis and Recognition. 15. Jahrgang, Nr. 3, 2012, S. 243–251, doi:10.1007/s10032-011-0168-2 (englisch).

- ↑ Jan jr. Hajič, Pavel Pecina: The MUSCIMA++ Dataset for Handwritten Optical Music Recognition. 14th International Conference on Document Analysis and Recognition. Kyoto, Japan 2017, S. 39–46, doi:10.1109/ICDAR.2017.16 (englisch).

- ↑ Lukas Tuggener, Ismail Elezi, Jürgen Elezi, Marcello Pelillo, Thilo Stadelmann: DeepScores – A Dataset for Segmentation, Detection and Classification of Tiny Objects. 24th International Conference on Pattern Recognition. Beijing, China 2018, doi:10.21256/zhaw-4255 (englisch).

- ↑ Jorge Calvo-Zaragoza, David Rizo: Camera-PrIMuS: Neural End-to-End Optical Music Recognition on Realistic Monophonic Scores. 19th International Society for Music Information Retrieval Conference. Paris, France 2018, S. 248–255 (englisch, ircam.fr [PDF]).

- ↑ Jorge Calvo-Zaragoza, Jose Oncina: Recognition of Pen-Based Music Notation: The HOMUS Dataset. 22nd International Conference on Pattern Recognition. 2014, S. 3038–3043, doi:10.1109/ICPR.2014.524 (englisch).

- ↑ Emilia Parada-Cabaleiro, Anton Batliner, Alice Batliner, Björn Schuller: The SEILS Dataset: Symbolically Encoded Scores in Modern-Early Notation for Computational Musicology. 18th International Society for Music Information Retrieval Conference. Suzhou, China 2017, S. 575–581 (englisch, ismir.net [PDF]).

- ↑ Alexander Pacha, Horst Eidenberger: Towards a Universal Music Symbol Classifier. 14th International Conference on Document Analysis and Recognition. Kyoto, Japan 2017, S. 35–36, doi:10.1109/ICDAR.2017.265 (englisch).

- ↑ Aruspix

- ↑ Audiveris

- ↑ CANTOR

- ↑ Gamera

- ↑ Bertrand Coüasnon: DMOS: a generic document recognition method, application to an automatic generator of musical scores, mathematical formulae and table structures recognition systems. Sixth International Conference on Document Analysis and Recognition. 2001, S. 215–220, doi:10.1109/ICDAR.2001.953786 (englisch).

- ↑ OpenOMR

- ↑ Rodan

- ↑ Informationen über die Genauigkeit von capella-scan

- ↑ a b PhotoScore Ultimate 7

- ↑ PlayScore Pro

- ↑ iSeeNotes

- ↑ NotateMe Now

- ↑ MusicPal

- ↑ Sheet Music Scanner

- ↑ PlayScore 2

- ↑ Notation Scanner - Sheet Music

- ↑ Komp Create

- ↑ Info capella-scan

- ↑ FORTE Scan Light ( vom 22. September 2013 im Internet Archive)

- ↑ Scan Score

- ↑ MIDI-Connections SCAN 2.0 ( vom 20. Dezember 2013 im Internet Archive)

- ↑ Music Publisher Scanning Edition ( vom 13. April 2013 im Internet Archive)

- ↑ NoteScan

- ↑ OMeR

- ↑ PDFtoMusic

- ↑ ScorScan

- ↑ SharpEye

- ↑ VivaldiScan ( vom 24. Dezember 2005 im Internet Archive)

- ↑ SmartScore ( vom 17. April 2012 im Internet Archive)

- ↑ Noten scannen und bearbeiten – Ganz einfach mit ScanScore. Abgerufen am 19. Dezember 2019 (deutsch).

- ↑ FORTE 11 Premium. Abgerufen am 19. Dezember 2019 (deutsch).