Logistische Regression

Unter logistischer Regression oder Logit-Modell versteht man in der Statistik Regressionsanalysen zur (meist multiplen) Modellierung der Verteilung abhängiger diskreter Variablen. Wenn logistische Regressionen nicht näher als multinomiale oder geordnete logistische Regressionen gekennzeichnet sind, ist zumeist die binomiale logistische Regression für dichotome (binäre) abhängige Variablen gemeint. Die unabhängigen Variablen können dabei ein beliebiges Skalenniveau aufweisen, wobei diskrete Variablen mit mehr als zwei Ausprägungen in eine Serie binärer Dummy-Variablen zerlegt werden.

Im binomialen Fall liegen Beobachtungen der Art vor, wobei eine binäre abhängige Variable (den so genannten Regressanden) bezeichnet, deren Wert zusammen mit bekannten und festen Werten von Regressoren (Kovariablen, erklärenden Variablen) auftritt. bezeichnet die Anzahl der Beobachtungen.

Motivation[Bearbeiten | Quelltext bearbeiten]

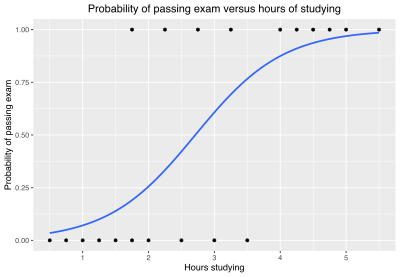

Die Einflüsse auf diskrete Variablen können nicht mit dem Verfahren der klassischen linearen Regressionsanalyse untersucht werden, da wesentliche Anwendungsvoraussetzungen, insbesondere eine Normalverteilung der Residuen und Homoskedastizität, nicht gegeben sind. Ferner kann ein lineares Regressionsmodell bei einer solchen Variablen zu unzulässigen Vorhersagen führen: Wenn man die beiden Ausprägungen der abhängigen Variablen mit 0 und 1 kodiert, so kann man zwar die Vorhersage eines linearen Regressionsmodells als Vorhersage der Wahrscheinlichkeit auffassen, dass die abhängige Variable den Wert 1 annimmt – formal: –, doch kann es dazu kommen, dass Werte außerhalb dieses Bereichs vorhergesagt werden. Die logistische Regression löst dieses Problem durch eine geeignete Transformation des Erwartungswerts der abhängigen Variablen .

Die Relevanz des Logit-Modells wird auch dadurch deutlich, dass Daniel McFadden und James Heckman im Jahr 2000 für ihren Beitrag zu seiner Entwicklung den Alfred-Nobel-Gedächtnispreis für Wirtschaftswissenschaften verliehen bekamen.

Das Modell der logistischen Regression ist ein Spezialfall des verallgemeinerten linearen Modells.

Modellspezifikation[Bearbeiten | Quelltext bearbeiten]

Mit sind die Werte der Regressorvariablen für die -te Beobachtung bezeichnet, mit sind die unbekannten Regressionskoeffizienten bezeichnet und mit

sind die Werte des so genannten linearen Prädiktors bezeichnet.

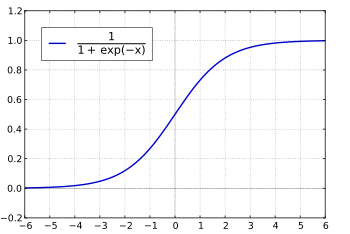

Die beobachteten Werte für der erklärten Variablen werden als Realisierungen stochastisch unabhängiger Bernoulli-verteilter Zufallsvariablen aufgefasst. Deren Bernoulli-Parameter hängt auf nichtlineare Art über die Verteilungsfunktion

der logistischen Verteilung, die auch logistische Funktion heißt, vom linearen Prädiktor und damit von den Werten der Regressorvariablen ab.

Das Modell der logistischen Regression postuliert dann für die Bernoulli-verteilten Zufallsvariablen :

- Die Zufallsvariablen sind stochastisch unabhängig,

- .

Eigenschaften[Bearbeiten | Quelltext bearbeiten]

Die Zufallsvariablen sind im Allgemeinen nicht identisch verteilt. Aus folgt, dass und identisch verteilt sind.

Für gilt:

Die logistische Funktion ist invertierbar. Die Umkehrfunktion

heißt auch Logit-Funktion. Zu einer Wahrscheinlichkeit heißt das Logit von .

Zur Interpretation[Bearbeiten | Quelltext bearbeiten]

Ausgehend von der Gleichung ist ersichtlich, dass gilt, was äquivalent zu ist.

Somit geht das Modell der logistischen Regression von der Idee Chancen (englisch odds) aus, d. h. dem Verhältnis von zur Gegenwahrscheinlichkeit (bei Kodierung der Alternativkategorie mit 0)

Die Chancen können zwar Werte größer 1 annehmen, doch ist ihr Wertebereich nach unten beschränkt (er nähert sich asymptotisch 0 an). Ein unbeschränkter Wertebereich wird durch die Transformation der Chancen in die sogenannten Logits

erzielt; diese können Werte zwischen minus und plus unendlich annehmen. Die Logits dienen als eine Art Kopplungsfunktion zwischen der Wahrscheinlichkeit und dem linearen Prädiktor. In der logistischen Regression wird dann die Regressionsgleichung

geschätzt; es werden also Regressionsgewichte bestimmt, nach denen die geschätzten Logits für gegebene Werte der Regressoren berechnet werden können. Die folgende Grafik zeigt, wie Logits (Ordinate) mit den Ausgangswahrscheinlichkeiten (Abszisse) zusammenhängen:

Die Regressionskoeffizienten der logistischen Regression sind nicht einfach zu interpretieren. Daher bildet man häufig die sogenannten Effektkoeffizienten durch Exponenzieren; die Regressionsgleichung bezieht sich dadurch auf die Chancen:

Betrachtet man nun die Änderung der der i-ten Untersuchungseinheit, wenn sich für die -te erklärte Variable () der Wert auf ändert, so betrachtet man:

Die Koeffizienten für werden oft auch als Effektkoeffizienten bezeichnet. Sie beschreiben das Chancenverhältnis, (eng. odds ratio) wenn sich um ändert. Hier bedeuten Effektkoeffizienten kleiner 1 einen negativen Einfluss auf die Chancen, ein positiver Einfluss ist gegeben, wenn .

Durch eine weitere Transformation lassen sich die Einflüsse der logistischen Regression auch als Einflüsse auf die Wahrscheinlichkeiten ausdrücken:

Schätzmethode und Likelihoodfunktion[Bearbeiten | Quelltext bearbeiten]

Anders als bei der linearen Regressionsanalyse ist eine direkte Berechnung der besten Regressionskurve nicht möglich. Deshalb wird zumeist mit einem iterativen Algorithmus[1] eine Maximum-Likelihood-Lösung geschätzt.

Aus den Modellannahmen ergibt sich die Likelihoodfunktion

deren numerische Maximierung bei fixierten Werten für zum Maximum-Likelihood-Schätzwert für den Parametervektor führt.

Falls einzelne Parameter interpretiert werden sollen, und nicht nur der lineare Prädiktor zur Prognose verwendet werden soll, ist Multikollinearität der Regressoren schädlich.

Aus den Maximum-Likelihood-Schätzwerten für die unbekannten Parameter erhält man durch Ersetzen die Schätzwerte

für die linearen Prädiktoren und die Schätzwerte

für die Wahrscheinlichkeiten .

Modelldiagnose[Bearbeiten | Quelltext bearbeiten]

Die Regressionsparameter werden auf der Grundlage des Maximum-Likelihood-Verfahrens geschätzt. Inferenzstatistische Verfahren stehen sowohl für die einzelnen Regressionskoeffizienten als auch für das Gesamtmodell zur Verfügung (siehe Wald-Test und Likelihood-Quotienten-Test).

Regressionsdiagnostik[Bearbeiten | Quelltext bearbeiten]

In Analogie zum linearen Regressionsmodell wurden Verfahren der Regressionsdiagnostik entwickelt, anhand derer einzelne Fälle mit übergroßem Einfluss auf das Ergebnis der Modellschätzung identifiziert werden können. Es gibt auch einige Vorschläge zur Berechnung einer Größe, die in Analogie zum Bestimmtheitsmaß der linearen Regression eine Abschätzung der „erklärten Variation“ erlaubt; man spricht hier von sogenannten Pseudo-Bestimmtheitsmaßen. Auch das Informationskriterium nach Akaike und das bayessche Informationskriterium werden in diesem Kontext gelegentlich herangezogen. Ebenfalls wird die ROC-Kurve zur Beurteilung der Vorhersagekraft logistischer Regressionen verwendet, wobei die Fläche unter der ROC-Kurve (kurz: AUROC) als Gütekriterium fungiert.[2]

Hosmer-Lemeshow-Test[Bearbeiten | Quelltext bearbeiten]

Insbesondere bei Modellen zur Risikoadjustierung wird häufig der Hosmer-Lemeshow-Test zur Bewertung der Anpassungsgüte verwendet.[3][4] Die Berechnung der Testgröße beruht auf den beobachteten Werten und den Schätzwerten

für die Eintrittswahrscheinlichkeiten. Die Grundidee dieses Tests ist, dass sich für eine Teilmengen der Untersuchungseinheiten mit ähnlichen geschätzten Eintrittswahrscheinlichkeiten die beobachteten relativen Häufigkeiten der eingetretenen Ereignisse und die durchschnittlichen geschätzten Eintrittswahrscheinlichkeiten nicht zu stark unterscheiden.

Alternativen und Erweiterungen[Bearbeiten | Quelltext bearbeiten]

Eine Erweiterung der logistischen Regression stellt die ordinale logistische Regression (Geordnete logistische Regression) dar; eine Variante dieser ist das kumulative Logit-Modell.

Als (im Wesentlichen gleichwertige) Alternative kann das Probit-Modell herangezogen werden, bei dem eine Normalverteilung zugrunde gelegt wird.

Eine Übertragung der logistischen Regression (und des Probit-Modells) auf eine abhängige Variable mit mehr als zwei diskreten Merkmalen ist möglich – dies ist die multinomiale logistische Regression.

Literatur[Bearbeiten | Quelltext bearbeiten]

- Alan Agresti: Categorical Data Analysis. 2. Auflage. Wiley, New York 2002, ISBN 0-471-36093-7.

- Hans-Jürgen Andreß, J.-A. Hagenaars, Steffen Kühnel: Analyse von Tabellen und kategorialen Daten. Springer, Berlin 1997, ISBN 3-540-62515-1.

- David M. Hosmer, Stanley Lemeshow, Rodney X. Sturdivant: Applied Logistic Regression (= Wiley Series in Probability and Statistics). 3. Auflage. Wiley, Hoboken 2013, ISBN 978-0-470-58247-3, doi:10.1002/9781118548387.

- Dieter Urban: Logit Analyse. Lucius & Lucius, Stuttgart 1998, ISBN 3-8282-4306-1.

- Scott J. Long: Regression Models for Categorical and Limited Dependent Variables. Sage 1997, ISBN 0-8039-7374-8.

- Gerhard Tutz: Die Analyse kategorialer Daten – Anwendungsorientierte Einführung in Logit-Modellierung und kategoriale Regression. Oldenbourg, München / Wien 2000, ISBN 3-486-25405-7, Kap. 2 Logistische Regression und Logit-Modell für binäre abhängige Größe, S. 29–65.

- Gerhard Tutz: Regression for Categorical Data. Cambridge University Press, Cambridge 2012, ISBN 978-1-107-00965-3, Kap. 2 Binary Regression: The Logit Model, S. 29–50.

Weblinks[Bearbeiten | Quelltext bearbeiten]

- Rede von Daniel McFadden zur Nobelpreisverleihung: Geschichte der Logit-Regression (englisch)

- Einführung in die Logistische Regression mit SPSS (PDF; 2,2 MB)

Einzelnachweise[Bearbeiten | Quelltext bearbeiten]

- ↑ Paul David Allison: Logistic regression using the SAS system theory and application. SAS Institute, Cary NC 1999, S. 48.

- ↑ David M. Hosmer, Stanley Lemeshow, Rodney X. Sturdivant: Applied logistic regression. 2013, Abschnitt 5.2.4 Area Under the ROC Curve.

- ↑ David W. Hosmer, Stanley Lemeshow: Goodness of fit tests for the multiple logistic regression model. In: Communications in Statistics – Theory and Methods. Band 9, Nr. 10, 1980, S. 1043–1069, doi:10.1080/03610928008827941.

- ↑ David M. Hosmer, Stanley Lemeshow, Rodney X. Sturdivant: Applied logistic regression. 2013, Abschnitt 5.2.2 The Hosmer-Lemeshow Tests.

![{\displaystyle \mathrm {E} [Y_{i}]=\mathrm {P} (Y_{i}=1)=F(\eta _{i})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f2242e8915bdcfea2ceac217db484bd77172a5af)

![{\displaystyle \mathrm {Var} [Y_{i}]=\mathrm {P} (Y_{i}=1)(1-\mathrm {P} (Y_{i}=1)=F(\eta _{i})F(-\eta _{i})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b9138fc13e6b6c26869220c8d5d251be445fba41)